Reinforcement learning حوزهای از یادگیری ماشین است. این حوزه در مورد انجام اقدامات مناسب برای به حداکثر رساندن پاداش در یک موقعیت خاص است. این امر توسط نرمافزارها و ماشینهای مختلف برای یافتن بهترین رفتار ممکن یا مسیری که باید در یک موقعیت خاص طی کند، بکار گرفته میشود. یادگیری تقویتی با یادگیری نظارت شده متفاوت است بهگونهای که در یادگیری نظارت شده دادههای آموزشی دارای برچسب پاسخ هستند؛ بنابراین مدل با پاسخ صحیح خود، آموزش داده میشود درحالیکه در یادگیری تقویتی برچسبی وجود ندارد؛ اما عامل تقویتکننده تصمیم میگیرد که چه کاری انجام دهد تا وظیفه داده شده را به بهترین نحوه انجام دهد. در نتیجه در این نوع یادگیری در غیاب یک مجموعه داده آموزشی، مدل باید از تجربه خود درس بگیرد. این نوع یادگیری ماشین، مزایا و معایب مخصوص خود را دارد.

RL از الگوریتمهایی استفاده میکند که از نتایج آموزش میبیند و تصمیم میگیرند کدام اقدام بعدی را انجام دهند. پس از هر اقدام، الگوریتم بازخوردی دریافت میکند که به آن کمک میکند تشخیص دهد که آیا انتخابی که انجام داده درست یا خنثی یا نادرست بوده است. این یک تکنیک خوب برای استفاده از سیستمهای خودکار است که باید تصمیمات کوچک زیادی را بدون راهنمایی انسان بگیرند.

یادگیری تقویتی یک سیستم خودمختار و خودآموز است که اساساً با آزمون و خطا یاد میگیرد. اقداماتی را با هدف به حداکثر رساندن پاداش انجام می دهد، یا به عبارت دیگر، یادگیری از طریق انجام به منظور دستیابی به بهترین نتایج است.

مثال:

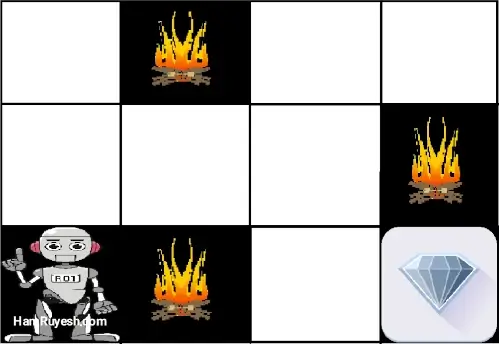

مشکل از این قرار است: ما یک عامل و یک پاداش داریم، با موانع زیادی در این بین. عامل قرار است بهترین مسیر ممکن را برای رسیدن به پاداش پیدا کند. مشکل زیر مسئله را راحتتر توضیح میدهد.

تصویر بالا ربات، الماس و آتش را نشان میدهد. هدف ربات دریافت پاداشی است که الماس است و از موانعی که شلیک میشوند دوری کند. ربات با امتحان تمام مسیرهای ممکن و سپس انتخاب مسیری که با کمترین موانع به او پاداش میدهد، یاد میگیرد. هر مرحله درست به ربات جایزه میدهد و هر قدم اشتباه پاداش ربات را کم میکند. کل پاداش زمانی محاسبه میشود که به پاداش نهایی یعنی الماس برسد.

نکات اصلی در Reinforcement learning

- ورودی: ورودی باید حالت اولیهای باشد که مدل از آن شروع میشود

- خروجی: خروجیهای ممکن زیادی وجود دارد؛ زیرا راهحلهای مختلفی برای یک مشکل خاص وجود دارد

- آموزش: آموزش مبتنی بر ورودی است، مدل حالتی را برمیگرداند و کاربر تصمیم میگیرد که مدل را بر اساس خروجی آن پاداش یا تنبیه کند.

- مدل همچنان به یادگیری ادامه میدهد.

- بهترین راهحل بر اساس حداکثر پاداش تصمیمگیری میشود.

هم رویش منتشر کرده است:

آموزش یادگیری ماشین از صفر — یادگیری سریع و آسان

تفاوت بین یادگیری تقویتی و یادگیری تحت نظارت

| یادگیری تقویتی |

یادگیری تحت نظارت |

| در یادگیری تقویتی همه چیز در مورد تصمیمگیری متوالی است. به عبارت ساده میتوان گفت که خروجی به وضعیت ورودی فعلی و ورودی بعدی به خروجی ورودی قبلی بستگی دارد. | در یادگیری با نظارت، تصمیم بر اساس ورودی اولیه یا ورودی داده شده به مدل در شروع کار گرفته میشود. |

|

در یادگیری تقویتی تصمیمگیری وابسته است، بنابراین ما به دنبالهای از تصمیمات وابسته برچسب میدهیم.

|

در یادگیری نظارت شده، تصمیمات مستقل از یکدیگر هستند، بنابراین به هر تصمیم برچسبهایی داده میشود.

|

| مثال: بازی شطرنج، خلاصه متن | مثال: تشخیص اشیا، تشخیص هرزنامه |

انواع یادگیری تقویتی

- مثبت: تقویت مثبت زمانی تعریف میشود که یک رویداد به دلیل یک رفتار خاص رخ میدهد، قدرت و فراوانی رفتار را افزایش میدهد. به عبارت دیگر تأثیر مثبتی بر رفتار دارد.

مزایای یادگیری تقویتی مثبت عبارتاند از:

- عملکرد مدل را به حداکثر میرساند.

- تغییر را برای مدت طولانی حفظ میکند.

- تقویت بیش از حد میتواند منجر به بار بیش از حد حالتها شود که میتواند نتایج را کاهش دهد.

- منفی: تقویت منفی به عنوان تقویت رفتاری تعریف میشود تا یک وضعیت منفی و بد متوقف یا از آن اجتناب شود.

مزایای یادگیری تقویتی منفی عبارتاند از:

- رفتار را افزایش میدهد.

- سرپیچی مدل نسبت به عملکرد مورد انتظار را به حداقل میرساند.

- این مدل فقط برای بدست آوردن حداقل رفتار مناسب ولی بهاندازه کافی استفاده میشود.

عناصر Reinforcement learning

عناصر یادگیری تقویتی به شرح زیر است:

- خط مشی (سیاست)

- تابع پاداش

- تابع ارزش

- مدل محیط

- خط مشی: سیاست چگونه رفتار کردن عامل یادگیرنده طی یک دوره زمانی معین را تعریف میکند. این یک نگاشت برداری از حالتهای دیده شده از محیط به اقداماتی است که در آن حالتها باید انجام شود.

- تابع پاداش: تابع پاداش برای تعریف یک هدف در یک مسئله یادگیری تقویتی استفاده میشود. تابع پاداش تابعی است که یک امتیاز عددی بر اساس وضعیت محیط ارائه میدهد.

- تابع ارزش: توابع ارزش مشخص میکنند که چه چیزی در بلندمدت خوب است. ارزش یک حالت، مقدار کل پاداشی است که یک عامل میتواند انتظار داشته باشد در آینده جمعآوری کند، از آن حالت شروع میشود.

- مدل محیط: مدل شبیهسازی شده محیط مورد نظر که برای برنامهریزی استفاده میشود.

- مشکل تخصیص اعتبار: الگوریتمهای یادگیری تقویتی یاد میگیرند که یک ارزش درونی برای حالتهای میانی تولید کنند که نشان میدهد چقدر در رسیدن به هدف خوب هستند. تصمیمگیرنده این یادگیری، عامل نامیده میشود. عامل با محیطی که شامل همه چیز خارج از این عامل است، تعامل دارد. عامل دارای حسگرهایی برای تصمیمگیری در مورد وضعیت خود در محیط است و اقداماتی را انجام میدهد که وضعیت آن را تغییر میدهد.

- مدل مسئله یادگیری تقویتی، عاملی است که به طور مداوم با یک محیط در تعامل است. عامل و محیط در یک توالی از مراحل زمانی با هم تعامل دارند. در هر مرحله زمانی t، عامل وضعیت محیط و یک پاداش عددی برای اقدام قبلی دریافت میکند و سپس عامل یک عمل را انتخاب میکند. یادگیری تقویتی تکنیکی برای حل مسائل تصمیم مارکوف است.

- RL از یک چارچوب مشخص استفاده میکند که تعامل بین یک عامل یادگیری و محیط آن را از نظر حالتها، اقدامات و پاداشها تعریف میکند. در نظر گرفته شده است که این چارچوب راهی ساده برای نمایش ویژگیهای اساسی مسئله هوش مصنوعی باشد.

کاربردهای مختلف یادگیری تقویتی

- Reinforcement Learning را میتوان در رباتیک برای اتوماسیون صنعتی استفاده کرد.

- Reinforcement Learning را میتوان در یادگیری ماشین و پردازش داده استفاده کرد

- از Reinforcement Learning میتوان برای ایجاد سیستمهای آموزشی استفاده کرد که دستورالعملها و مواد سفارشی را مطابق با نیاز دانشآموزان ارائه میدهد.

دیگر کاربردهای یادگیریهای تقویتی

- رباتهایی با عملگرهای از پیش برنامهریزیشده در محیطهای ساختاریافته، مانند خط مونتاژ یک کارخانه خودروسازی که در آن کار ماهیتی تکراری دارد، مفید هستند.

- میتواند به عنوان یک شطرنجباز چیرهدست حرکتی انجام میدهد. انتخاب حرکت بعدی با درنظرگرفتن همزمان طرحریزی و همچنین پیشبینی پاسخهای احتمالی حریف اعلام میشود.

- یک کنترلکننده تطبیقی پارامترهای عملکرد یک پالایشگاه نفت را در زمان واقعی تنظیم میکند.

Reinforcement Learning را میتوان در محیطهای بزرگ در شرایط زیر استفاده کرد:

- مدلی از محیط شناخته شده است، اما یک راهحل تحلیلی در دسترس نیست.

- فقط یک مدل شبیهسازی از محیط ارائه شده است (موضوع بهینهسازی مبتنی بر شبیهسازی)

- تنها راه جمعآوری اطلاعات در مورد محیط، تعامل با آن است و دیگر روشهای یادگیری ماشین ممکن نیست.

هم رویش منتشر کرده است:

یادگیری ماشین ــ تندخوانی کتاب جرون

مزایا و معایب یادگیری تقویتی

مزایای RL

- یادگیری تقویتی میتواند برای حل مسائل بسیار پیچیدهای که با تکنیکهای مرسوم قابلحل نیستند استفاده شود

- مدل میتواند خطاهای رخداده در طول فرایند آموزش را تصحیح کند.

- در RL، دادههای آموزشی از طریق تعامل مستقیم عامل با محیط به دست میآید.

- RL میتواند محیطهایی را کنترل کند که غیرقطعی هستند، به این معنی که نتایج اقدامات همیشه قابلپیشبینی نیستند. این در برنامههای دنیای واقعی که محیط ممکن است در طول زمان تغییر کند یا نامشخص باشد مفید است.

- یادگیری تقویتی میتواند برای حل طیف وسیعی از مسائل، از جمله مسائلی که شامل تصمیمگیری، کنترل و بهینهسازی است، استفاده شود.

- RL یک رویکرد منعطف است که میتواند با سایر تکنیکهای یادگیری ماشینی، مانند یادگیری عمیق، برای بهبود عملکرد ترکیب شود.

معایب RL

- استفاده از یادگیری تقویتی برای حل مسائل ساده ترجیح داده نمیشود.

- یادگیری تقویتی به دادههای زیاد و محاسبات زیادی نیاز دارد

- یادگیری تقویتی بهشدت به کیفیت تابع پاداش بستگی دارد. اگر تابع پاداش بد طراحی شده باشد، ممکن است عامل رفتار مورد نظر را یاد نگیرد.

- اشکالزدایی و تفسیر یادگیری تقویتی میتواند دشوار باشد. همیشه مشخص نیست که چرا عامل به شیوهای خاص رفتار میکند که میتواند تشخیص و رفع مشکلات را دشوار کند.

پیادهسازی در پایتون

import gym

import numpy as np

# Define the Q-table and learning rate

q_table = np.zeros((state_size, action_size))

alpha = 0.8

gamma = 0.95

# Train the Q-Learning algorithm

for episode in range(num_episodes):

state = env.reset()

done = False

while not done:

# Choose an action

action = np.argmax(

q_table[state, :] + np.random.randn(1, action_size) * (1. / (episode + 1)))

# Take the action and observe the new state and reward

next_state, reward, done, _ = env.step(action)

# Update the Q-table

q_table[state, action] = (1 - alpha) * q_table[state, action] +

alpha * (reward + gamma * np.max(q_table[next_state, :]))

state = next_state

# Test the trained Q-Learning algorithm

state = env.reset()

done = False

while not done:

# Choose an action

action = np.argmax(q_table[state, :])

# Take the action

state, reward, done, _ = env.step(action)

env.render()

کلیدواژگان

یادگیری تقویتی | یادگیری ماشین | Reinforcement Learning چیست | کاربردهای یادگیری تقویتی کداماند | انواع یادگیری تقویتی | مدل یادگیری تقویتی چگونه کار میکند | Machine learning | برنامه نویسی یادگیری تقویتی | هوش مصنوعی | مزایا و معایب یادگیری تقویتی | مزایای یادگیری تقویتی | معایب یادگیری تقویتی | کاربرد یادگیری تقویتی | کاربردهای یادگیری تقویتی